Rédigé par : Frédéric Fannière

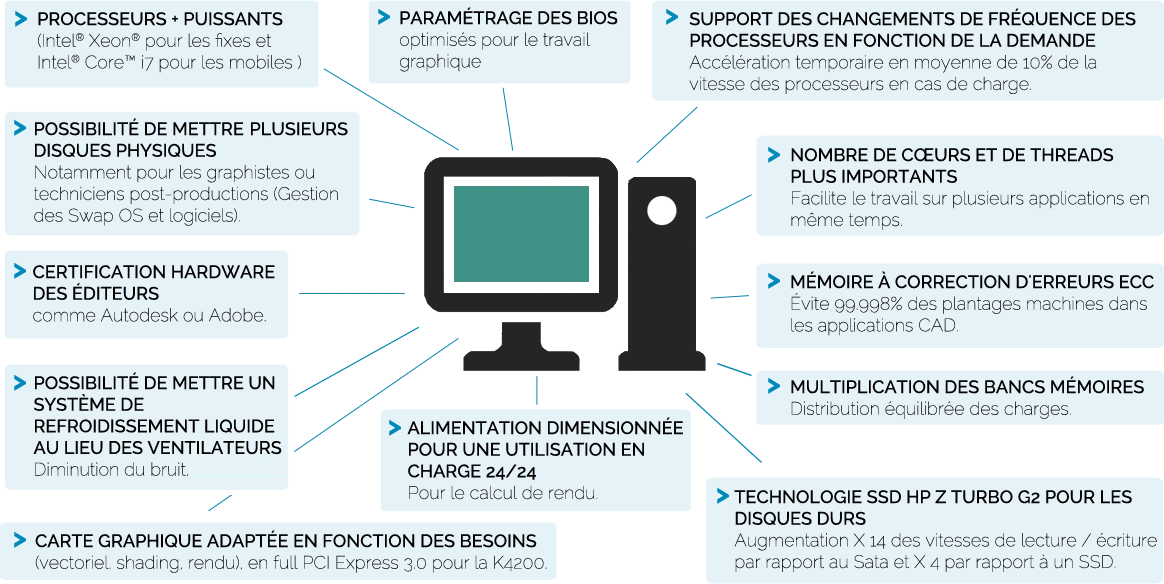

Nos 6 recommandations essentielles pour bien choisir sa station de travail

Du portable au desktop, nos 6 recommandations essentielles pour bien choisir sa station de travail pour toutes applications de CAO graphique telles que Revit, 3ds Max ou même AutoCAD.

Nous sommes aujourd’hui au milieu du gué. Depuis quelques années, la fameuse loi de Moore au sujet du doublement de la puissance des ordinateurs tous les ans à coût constant est derrière nous. Les fréquences des machines, indicateurs généraux de la vitesse d’une machine, stagnent. Multiplication des cœurs, qu’ils soient CPU ou GPU, hyperthreading, disques dur SSD SATA ou NVMe, turbo boost, cartes graphiques professionnelles ou grand public, virtualisation : le matériel n’a jamais autant évolué.

De ce fait, il devient de plus en plus complexe de bien choisir son outil de travail quotidien. Nous vous avons donc préparé une présentation claire des points à étudier lorsque se pose la question du remplacement de votre machine, à savoir le processeur, la mémoire vive (RAM), le stockage, la carte graphique, le châssis et enfin l’avenir de votre station de travail : la virtualisation de votre station BIM / CAO.

1 – Le processeur (CPU)

Les logiciels de CAO font un usage intensif du processeur et c’est le composant le plus important lorsque vous choisissez une station de travail. Les CPU (Central Processing Units) du fondeur Intel sont le standard dans la plupart des stations de travail du marché, que ce soit sur les mobiles (laptops) comme sur les modèles de bureau (desktops). Le choix doit se porter entre les gammes Intel Core ou Intel Xeon.

Deux points essentiels que vous devez considérer lors du choix du CPU :

- La vitesse d’horloge en GHz est le critère plus important. Une haute vitesse d’horloge en GHz assurera non seulement que votre logiciel de CAO (par exemple Revit ou dédié au BIM) fonctionnera plus vite et elle améliorera également sensiblement les performances générales du système, que ce soit celles du système d’exploitation (OS) ou de la gestion de l’affichage graphique.

- Le nombre de coeurs (cores). Les CPU d’aujourd’hui sont tous en multi-cœurs. Les CPU quad cores (4 cœurs) sont généralement un bon choix pour la plupart des logiciels de CAO. Utiliser un CPU avec plus de cœurs ne vous apportera pas plus, et risque d’entraîner une baisse de la vitesse d’horloge (GHz). Une exception cependant pour les travaux de visualisation. En effet, la plupart des moteurs de rendu font un usage plein et entier de tous les cœurs dans la réalisation des calculs, le traitement des opérations de rendu est parallélisé.

La plupart des fonctions des logiciels BIM ou CAO utilisent un seul cœur, c’est le cas d’Autodesk Revit 2017. Il y a des exceptions, mais en général, ces fonctions ne tirent profit que de 2 ou 3 cœurs. Par exemple, dans Revit, l’ouverture et la sauvegarde des fichiers ou l’affichage des nuages de points sont des fonctions multi-cœurs. Dans Archicad, l’intégralité du programme est multi-cœurs, ainsi vous tirez meilleur profit d’un processeur disposant de plus de cœurs.

Il n’est pas nécessaire d’avoir deux processeurs physiques dans sa station de travail lorsque l’on travaille avec des logiciels BIM pour la maquette numérique du bâtiment ou de CAO, sauf dans le cas où vous travaillez avec plusieurs applications lourdes telles que Autodesk Revit et Autodesk 3ds Max par exemple. Ainsi, dans ce cas, vous pouvez travailler avec Revit sur un processeur, et avec 3ds Max sur l‘autre, voire dans le cas des calculs de rendu, utiliser l’ensemble des cœurs des 2 processeurs.

Intel Xeon ou Core iX

En termes de performance pure, il n’y a pas de différence. La différence sera plutôt sur l’utilisation que l’on fait de sa machine. Les processeurs Xeon sont élaborés pour des tâches lourdes et intensives, ils prennent en charge la mémoire de type ECC, et bénéficient la plupart du temps du double de mémoire cache L3 (mémoire utilisée par les logiciels de CAO et de calcul). Si votre application supporte l’Hyperthreading alors le processeur Xeon est la solution. À contrario, les processeurs Intel Core i5/i7 supporte l’overclocking mais vous devez pour cela intervenir sur votre carte mère, et ils intègrent de facto un composant graphique interne, ce que n’a pas le Xeon.

Vers la fin de la loi de Moore

Nous avons tous entendu parler de cette fameuse règle annoncée à la fin des années 60 par Gordon Moore, l’un des trois fondateurs d’Intel, qui disait que le nombre de transistors utilisés dans un circuit intégré doublerait tous les ans. Et c’est vrai que de 1970 à nos jours, la capacité de traitement de nos PC doublait tous les deux ans. Et maintenant, c’est fini. Nous sommes arrivés à une limite qui ne sera pas franchie avant longtemps. Une limite physique d’abord, avec une gravure à 14 nanomètres de finesse, mais financière surtout, car la miniaturisation a un prix énorme, qu’aucun fondeur ne peut aujourd’hui supporter. En effet, les processeurs sont de plus en plus spécialisés en fonction des terminaux, les usages sont différents, la visibilité sur le marché, du coup, n’est pas aussi évidente que dans les années 1980. À cette époque Intel investissait des milliards de dollars dans la prochaine génération de CPU, mais l’industriel était assuré de les vendre, la micro-informatique battait son plein.

Aujourd’hui, qui peut assurer que son prochain outil de travail sera un PC ? À priori personne !

2 – La mémoire RAM

La mémoire d’une station de travail est essentielle pour charger le système d’exploitation, les applications et les jeux de données. Il est très important d’en avoir suffisamment pour travailler avec votre station de travail. Si, à un moment donné, vous venez à manquer de mémoire, alors le système d’exploitation remplacera l’espace manquant par une zone de swap sur le disque dur, ce qui aura pour conséquence de ralentir drastiquement le travail sur la machine.

Un excès de mémoire ne booste pas les performances, si vous n’utilisez jamais plus de 16 Go, par exemple, le fait d’avoir 32 Go n’améliorera pas les performances (pour voir combien de mémoire vous utilisez à tout moment, tapez sur CTRL+ALT+SUP et cliquez sur l’onglet Performances).

Il vous faudra également choisir le type de mémoire : avec ou sans code correcteur d’erreurs (Mémoire ECC ou pas). Les mémoires de type ECC contiennent un code correcteur leur permettant de détecter et corriger les types les plus courants de corruption de données; celles-ci ne pouvant pas être tolérées dans les calculs scientifiques ou financiers. Attention, la corruption des données ne vient pas d’un dysfonctionnement d’application, mais d’une altération de la valeur stockée par les réactions engendrées par les rayons cosmiques. Est-ce grave docteur ? Difficile de répondre, cela dépend bien évidemment de la répercussion de la transformation de la valeur du bit. L’écart de prix aujourd’hui entre les mémoires ECC et non ECC étant faible, nous vous conseillons de choisir les mémoires ECC.

Mémoires DDR3 ou DDR4

Les différences entre les mémoires DDR3 et DDR4 sont essentiellement de deux ordres : bande passante et consommation d’énergie. La DDR4 apporte une bande passante supérieure de 50% avec une consommation énergétique réduite de 40% sur le papier. Attention à la latence réelle, qui est une combinaison du temps de cycle d’horloge x nombre de cycle d’horloge. Et là les chiffres sont moins éloquents, finalement peu de différence entre les DDR3 et DDR4 en termes de vitesse. Cependant, il reste la consommation énergétique qui, elle, est bien moindre sur les DDR4.

3 – Les disques durs

Il y deux types de stockage pour vos données : les disques SSD qui utilisent de la mémoire flash et donc n’ont pas de composants mobiles et les disques HDD traditionnels qui utilisent des composants mécaniques en rotation.

Un disque dur SSD est hautement recommandé comme disque primaire pour le stockage de l’OS et des applications. Les vitesses de lecture/écriture sont de 3 à 14 fois supérieures à celles d’un disque dur classique. Il y a deux types de SSD : SATA et NVMe. Les disques avec contrôleur NVMe permettent d’obtenir des vitesses de lecture/écriture supérieures et sont plus adaptés lorsque vous travaillez avec des gros fichiers de données comme dans l’édition vidéo ou le traitement des nuages de points. Un disque SSD SATA est parfaitement approprié pour la plupart des workflows en CAO. Comme le prix du GB d’un SSD est 10 fois supérieur à celui d’un disque dur mécanique, la plupart des utilisateurs choisissent d’utiliser un HDD comme second disque dur pour stocker la masse de leurs données de leur maquettes numériques BIM ou CAO. La majorité des stations de travail, mis à part les ultra-portables, peuvent héberger deux disques ou plus.

4 – La carte graphique

Les logiciels BIM ou de CAO ont besoin de cartes graphiques pour vous permettre de naviguer autour de vos modèles 3D. Le GPU (Graphics Processing Unit) peut être embarquée dans le CPU comme les composants Intel HD Graphics ou Intel Iris Pro qui donne une puissance graphique moindre mais somme toute suffisante.

Pour des performances plus élevées, une carte à part entière est nécessaire. Ces cartes sont disponibles dans la plupart des desktops ou des modèles mobiles. Une carte professionnelle (AMD FirePro ou Nvidia Quadro) est recommandée car les drivers sont optimisés pour la CAO et le BIM comprenant les modèles 3D, et les GPU sont certifiés pour l’utilisation de la plupart des logiciels de CAO. De ce fait, vous trouverez toujours une réponse à un problème d’affichage.

Pour la plupart des logiciels BIM ou de CAO, une carte dite « d’entrée de gamme » ou de « milieu de gamme » est satisfaisante. Vous aurez besoin d’une carte plus puissante pour la visualisation, la réalité virtuelle ou lorsque vous utilisez des moteurs de rendu temps réel tels que Nvidia Iray ou V-ray RT de Chaos Group.

Nvidia : Quadro ou GeForce ?

Tout d’abord la gamme Quadro est développée pour les professionnels et la gamme GTX pour le grand public, ce qui veut dire que l’engagement de Nvidia n’est pas le même. Toutes les cartes Quadro sont certifiées ISV. En clair, j’achète une Quadro, le support Nvidia me répondra même trois ans après l’achat de ma carte sur un dysfonctionnement entre mon logiciel et ma carte graphique. Ce qui n’est pas le cas sur la gamme GTX. D’autre part, certaines fonctionnalités liées à la spécificité du traitement vectoriel sont intégrées en matériel sur les Quadro. L’affichage d’un modèle 3D est un peu plus précis avec une Quadro (Anti-aliasing sur point et ligne, gestion du multifenêtrage, etc..). Donc, quand j’achète une Quadro, j’achète la tranquillité avec l’engagement de Nvidia, de l’éditeur de logiciel et du constructeur de la machine, d’avoir une réponse à un problème pendant la durée de vie de ma station de travail avec mon logiciel BIM (Revit ou autres).

5 – Le châssis

Pour les mobiles, les critères principaux sont la taille de l’écran (15 ou 17 pouces), le clavier avec ou sans pavé numérique et le poids. Il faut également analyser la résolution native d’affichage du portable. En effet, pour un affichage clair de l’interface de logiciels de CAO, il est préférable de prendre en charge nativement une résolution de 1920 x 1200.

Pour les desktops, les dimensions du châssis sont importantes, et sont directement liées aux perspectives d’utilisation de la machine, aujourd’hui et dans les trois ans qui viennent.

Si votre utilisation majeure est de travailler avec Revit et AutoCAD, un modèle SFF bien dimensionné suffira amplement. De plus, sa consommation électrique sera de 200 W maximum.

Si vous souhaitez faire de la visualisation et du montage ainsi que travailler avec des logiciels de CAO, un châssis de type HP Z800 sera alors nécessaire pour loger les cartes graphiques adéquates ainsi que les multiples disques durs requis pour votre travail. Sachez tout de même que la consommation électrique de votre châssis pourra aller jusqu’à 1100 W ! Soit, au prix du kWh en date de parution, un coût allant de 130€ à 1500€ par an par machine suivant l’utilisation, ce qui est loin d’être négligeable.

6 – La virtualisation

La virtualisation est sans aucun doute l’avenir du secteur. Dans cinq ans, plus personne n’aura de postes de travail de type PC à ses pieds, ni de données lourdes et précieuses en local. Cela est d’autant plus inconcevable avec la nécessité d’un travail collaboratif de type total pour la maquette numérique du bâtiment (BIM). Nous avons commencé à virtualiser les postes non-graphiques il y a maintenant dix ans, mais nous étions toujours confrontés à la virtualisation du composant graphique. Aujourd’hui, nous maîtrisons cet aspect que ce soit avec des cartes spécifiques (Nvidia GRID) ou des composants internes aux nouveaux CPU (Intel G9).

La mise en place de la virtualisation ne se conçoit pas comme un simple changement de poste, à moins que l’on soit seul, car il faut aussi penser à l’infrastructure informatique de son entreprise. C’est l’une des raisons du frein à ce changement de paradigme. Ce que l’on peut affirmer c’est qu’aujourd’hui, techniquement, il n’y a pas de différence en termes de puissance. La virtualisation n’apporte que des avantages : plus de sécurité, plus de ROI, plus de souplesse, plus de sérénité en maintenance. Nous vous invitons d’ailleurs à nous contacter si vous souhaitez voir et essayer une suite Autodesk en fonctionnement virtuel depuis votre poste. Quoi qu’il en soit, une simulation et des tests réels de votre environnement de travail prenant en compte vos processus d’échanges de données sont obligatoires avec, notamment, une mesure de la satisfaction utilisateur avant et après. Cela s’appelle un POC (proof of concept). Nous sommes en mesure de vous proposer des simulations d’environnement de travail jusqu’à 60 postes de travail, de toute configuration possible : 2D/3D, calculs, simulation. Ensuite deux solutions s’offrent à vous : soit les serveurs (hôtes) de station de travail sont dans l’entreprise, soit ils sont à l’extérieur dans le « cloud », et là, nous parlons de DaaS (Desktop as a Service). Service que nous proposons aujourd’hui chez REFSA.

En résumé, une station de travail conçue pour la CAO vous apporte :